K-Meansクラスタリングの紹介

Updated on

K-Meansは、クラスタリングに使用される人気のある教師なし学習アルゴリズムです。類似したデータポイントをグループ化し、異なるものを別々にすることを目的とした、重心ベースの技術です。クラスタリングアルゴリズムは、顧客プロファイリング、データセグメンテーション、外れ値検出など、様々なアプリケーションで機械学習によく使用されます。

K-Meansクラスタリングとは?

K-Meansクラスタリングは、K個の異なるクラスタにデータセットを分割するために使用される方法で、各データポイントは最も近い平均または重心を持つクラスタに属します。与えられたデータスペース内のデータポイントの類似性を見つけ、それらをグループ化する方法です。

K-Meansクラスタリングの働き方

K-Meansクラスタリングは、K個の重心をランダムに初期化して始めます。次に、ユークリッド距離などの距離メトリックに基づいて、各データポイントを最も近い重心に割り当てます。重心が再計算され、プロセスが重心が大きく変化しなくなるか、事前に定義された条件が満たされるまで繰り返されます。

K-Meansクラスタリングの利点と欠点

利点

- シンプルさ:K-Meansは、Pythonで理解しやすく実装することができます。

- 効率性:K-Meansは計算効率が高く、大きなデータセットに適しています。

- スケーラビリティ:K-Meansは、多数の変数を持つ大規模なデータセットを処理するためにスケールすることができます。

欠点

- クラスタの数:クラスタの数(K)は事前に指定する必要があります。

- 初期化の感度:アルゴリズムの結果は、重心の初期配置に依存する場合があります。

- 外れ値:K-Meansは、外れ値に敏感で、重心とその結果のクラスタを歪めることがあります。

K-Meansクラスタリングのアプリケーション

K-Meansには多数のアプリケーションがあり、以下が挙げられます。

- 顧客プロファイリング:企業はK-Meansを使用して、顧客ベースをセグメント化し、マーケティング戦略を適用することができます。

- 外れ値検出:K-Meansは、詐欺検出やネットワークセキュリティなどの分野で重要なデータセットの異常や外れ値を識別するために使用できます。

- 次元削減:K-Meansは、データの次元を減らし、可視化や解釈を容易にするために使用できます。

PythonでのK-Meansクラスタリングの実装

Pythonのsklearnライブラリを使用すると、K-Meansを簡単に実装できます。以下は基本的な例です:

from sklearn.cluster import KMeans

## Fit the model to the data

kmeans = KMeans(n_clusters=3)

kmeans.fit(data)

## Get the cluster assignments for each data point

labels = kmeans.labels_pandasを使用してデータを操作および前処理することができます。pandas操作の復習が必要な場合は、ModinまたはPyGWalker (opens in a new tab)をチェックしてください。

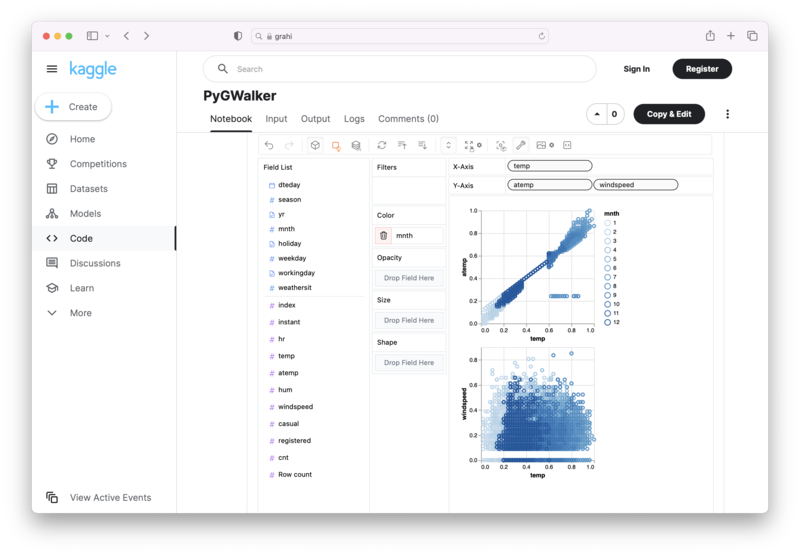

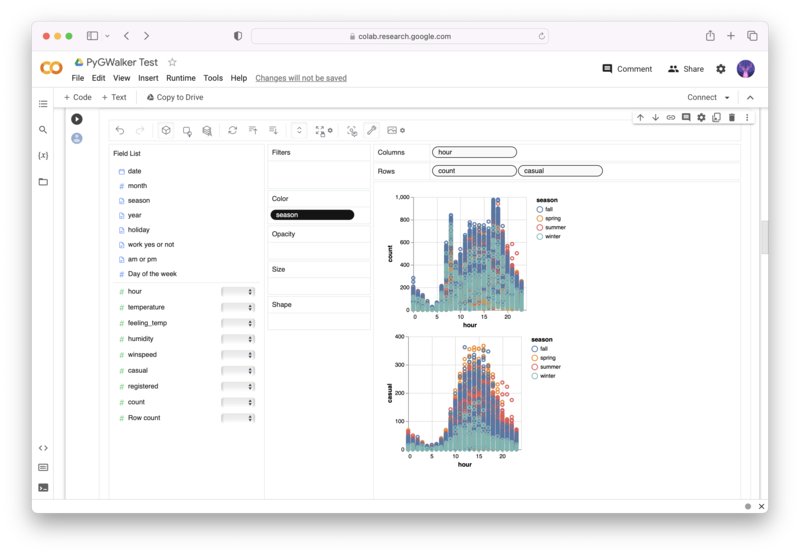

Pythonで素早くデータ可視化を作成したいですか?

PyGWalkerは、Jupyter Notebookベースの環境内で直接データ分析および可視化のワークフローを加速するのに役立つオープンソースのPythonプロジェクトです。

PyGWalker (opens in a new tab)は、Pandasデータフレーム(またはPolarsデータフレーム)を視覚的なUIに変換し、変数をドラッグ&ドロップして簡単にグラフを作成できるようにします。以下のコードを使用してください:

pip install pygwalker

import pygwalker as pyg

gwalker = pyg.walk(df)今すぐオンラインノートブックでPyGWalkerを実行できます:

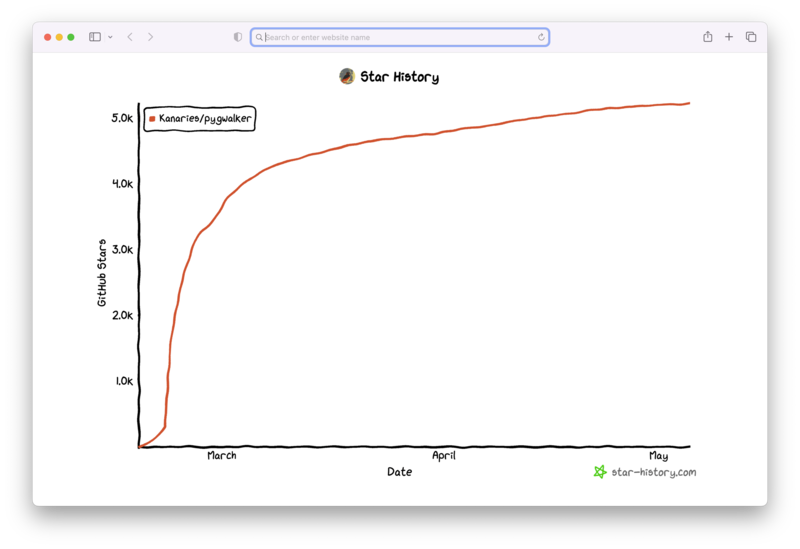

そして、GitHubで私たちに⭐️を与えるのを忘れないでください!

| Kaggle NotebookでPyGWalkerを実行 (opens in a new tab) | Google ColabでPyGWalkerを実行 (opens in a new tab) | PyGWalkerに⭐️を与える (opens in a new tab) |

|---|---|---|

(opens in a new tab) (opens in a new tab) |  (opens in a new tab) (opens in a new tab) |  (opens in a new tab) (opens in a new tab) |

クラスタリング評価指標

評価指標は、クラスタの品質を定量化するのに役立ちます。以下は2つの一般的に使用される指標です。

- シルエット係数:オブジェクトが他のクラスタに比べて自分のクラスタにどの程度似ているかを測定します。

- 慣性:クラスタ内の平方和の合計を測定します。慣性値が低いほど、クラスタの凝集度が高くなります。

K-Meansと他のクラスタリングアルゴリズムの比較

K-Means vs. ガウス混合モデル(GMM)

K-Meansとガウス混合モデル(GMM)はどちらもクラスタリングアルゴリズムですが、根本的な違いがあります。 K-Meansはハードクラスタリング法であり、データポイントは完全に1つのクラスタに属します。対照的に、GMMは各クラスタに属する確率を提供するソフトクラスタリング法です。

K-Means vs. 階層クラスタリング

K-Meansは、クラスタ数を事前に指定する必要がありますが、階層的クラスタリングにはこの必要はありません。階層的クラスタリングはクラスタのツリーを作成し、異なるレベルで視覚化および解釈することができ、データ構造に関するより細かい情報を提供します。

クラスタリングのユースケース

クラスタリングには、異なる分野で多数のユースケースがあります。

- マーケティング:顧客セグメンテーションにより、顧客の行動をよりよく理解し、マーケティング戦略をカスタマイズします。

- 銀行業界:通常の動作から外れた異常値として不正取引を検出するために使用します。

- ヘルスケア:個人向け治療計画のために、医療歴に基づく患者セグメンテーションを行います。

クラスター数の選択

K-Meansにおいて、適切なクラスター数の選択は重要です。一般的な方法は、クラスター数を変えた時の説明される分散の変化をプロットし、曲線の曲がり角をクラスター数として選択するエルボー法です。

K-Meansによる外れ値検出

K-Meansは外れ値検出に利用できます。割り当てられたクラスターの重心から遠いデータ点は外れ値と考えられます。

クラスタリングにおける教師なし学習の利点

クラスタリングなどの教師なし学習には、先行知識やトレーニングがなくてもデータ内のパターンや構造を発見するという利点があります。これにより、ラベルの付いていないデータがある場合に特に有用です。

結論

K-Meansクラスタリングは、機械学習のツールボックスの中でも強力なツールです。その簡単さと汎用性から、顧客セグメンテーションから外れ値検出まで、様々なタスクにおいて優れた選択肢となります。K-Meansクラスタリングがどのように動作し、どのような応用があるかを理解し、自分自身のデータサイエンスプロジェクトでK-Meansクラスタリングを使い始める準備が整います。